专线 + SD-WAN 异构双路径接入阿里云高可用架构实战

发布日期: 2026-03-20作者: 网络解决方案架构师浏览: 188

1. 设计概述

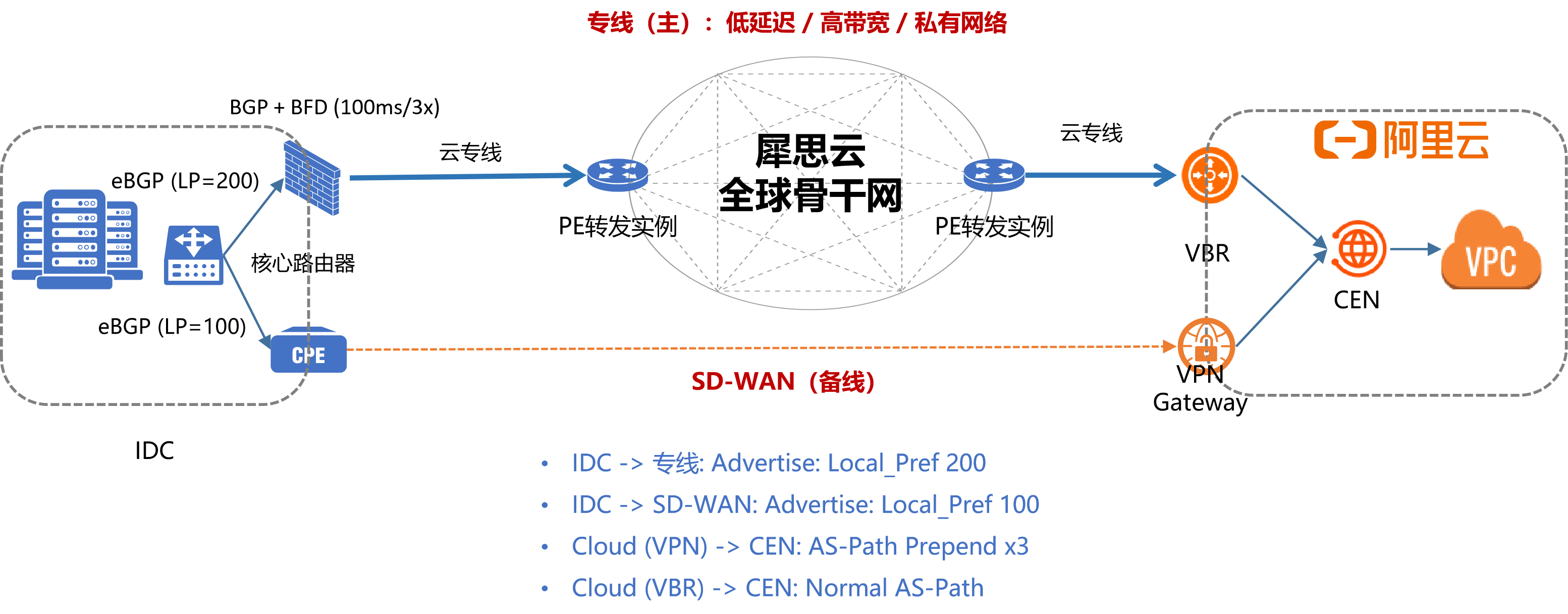

本设计旨在构建一套具备电信级可靠性与成本效益的混合云接入架构。通过解耦控制平面与数据平面,利用阿里云云企业网(CEN)作为路由枢纽,实现“物理专线主用、SD-WAN 智能备用”的异构双活/主备模式。

核心设计目标:

- 高可用性 (HA): 实现链路故障秒级检测与自动切换(RTO < 4s)。

- 路由可控性: 基于 BGP 属性(Local_Pref, AS_Path, MED)实现精细化的流量工程。

- 运维可视化: 引入 SD-WAN 解决传统 IPsec 的黑盒运维痛点,提供端到端质量感知。

- 架构弹性: 支持未来多分支、多云区域的无缝扩展。

2. 逻辑拓扑架构

2.1 总体架构图解

2.2 组件角色定义

| 组件 | 角色定位 | 关键协议/功能 | 设计约束 |

|---|---|---|---|

| Core Router | 路由决策中心 | eBGP, BFD | 需支持多路径负载分担或主备优先级调整;必须开启 BFD 联动。 |

| 物理专线 | 主数据通道 | Ethernet, VLAN, eBGP | 私有网络,低延迟,高成本。作为默认首选路径。 |

| SD-WAN CPE | 智能备通道 | IPsec/GRE, Overlay BGP, QoS | 利用公网资源,提供智能选路、链路质量探测及可视化。 |

| 阿里云 CEN | 路由交换中枢 | Route Map, Route Table | 负责云端路由的统一分发与策略控制,防止路由环路。 |

| VPN Gateway | 云端终结点 | IPsec, BGP over IPsec | 建议使用阿里云原生高可用 VPN 网关,避免自建 ECS 带来的单点风险。 |

3. 寻址与网络规划

为避免地址冲突并确保路由可达性,需严格规划以下地址段。严禁使用重叠网段。

3.1 互联地址规划

| 链路类型 | 位置 | 接口描述 | 建议网段 (CIDR) | 备注 |

|---|---|---|---|---|

| 物理专线 | IDC 侧 (Core) | Connect to Transceiver | 10.255.0.0/30 |

点对点互联,掩码 /30 或 /29 (预留延伸监控地址) |

| 阿里云侧 (VBR) | Connect to Physical Port | 10.255.0.1/30 |

阿里云侧通常占用 .1 | |

| SD-WAN 隧道 | IDC 侧 (CPE LAN) | Connect to Core Router | 10.255.1.0/30 |

CPE 与核心路由器的内网互联 |

| IDC 侧 (CPE WAN) | Connect to Internet | DHCP / Static Public IP | 需固定公网 IP 以简化云端 ACL | |

| 阿里云侧 (VPN) | Tunnel Interface | 169.254.x.x/30 |

阿里云 BGP over IPsec 保留段 (Link-Local) |

3.2 业务网段规划

| 区域 | 业务网段示例 | 通告方式 | 备注 |

|---|---|---|---|

| 本地 IDC | 192.168.10.0/24(DB)192.168.20.0/24(App) |

双向通告至 VBR 和 CPE | 需在两端 BGP 中精确聚合,避免泄露默认路由 |

| 阿里云 VPC | 172.16.0.0/16 |

由 CEN 统一通告至 VBR 和 VPN | 云端需配置路由策略,区分主次路径 |

3.3 MTU 规划

由于 SD-WAN 隧道封装会增加报文头开销,必须调整 MTU 以防止分片导致的性能下降。

- 物理接口 MTU: 1500 Bytes (标准以太网)

- 专线逻辑接口 MTU: 1500 Bytes

- SD-WAN 隧道接口 MTU: 1400 Bytes (预留 100 Bytes 给封装头)

- TCP MSS Clamping: 建议在 Core Router 和 CPE 的出方向接口配置

tcp mss adjust 1360。

4. 路由策略与控制平面设计

本方案完全依赖 BGP 进行路径优选,不依赖静态路由,以确保动态收敛能力。

4.1 路由传播方向与属性控制

4.1.1 去程流量 (IDC -> Cloud)

目标: 优先走专线,专线故障自动切至 SD-WAN。

-

实现机制: 在 IDC Core Router 上对从不同邻居学到的云网段路由设置不同的 Local Preference (本地优先级)。

-

策略详情:

-

来自专线 (VBR): 设置

Local_Pref = 200(高优)。 -

来自 SD-WAN (CPE): 设置

Local_Pref = 100(默认/低优)。 -

预期行为: Core Router 路由表中,云网段下一跳指向专线接口。当专线 BGP 会话 Down 掉,路由自动撤销,次优的 SD-WAN 路由生效。

4.1.2 回程流量 (Cloud -> IDC)

目标: 云端返回流量优先经专线回到 IDC,避免非对称路由。

-

实现机制: 在 阿里云 CEN (转发路由器) 上配置 Route Map (路由映射),修改从 VPN 网关学到的路由属性。

-

策略详情:

-

来自 VBR 的路由: 保持默认属性。

-

来自 VPN 网关的路由: 执行

AS-Path Prepend(追加 2-3 次本地 AS 号) 或降低Preference(如果支持)。 -

注: 阿里云 CEN 目前主要支持通过路由表优先级和发布策略控制。更稳健的做法是在 IDC 侧通告路由时,通过 SD-WAN 通告的路径携带更长的 AS-Path 或更大的 MED 值,影响云端选路(取决于云端 BGP 实现细节,通常云端优选 AS-Path 短的)。

-

推荐方案: 在 IDC Core Router 向 CPE 通告路由时,人为

AS-Path Prepend3 次。这样云端收到的两条路由中,经 VPN 来的路径 AS-Path 更长,自然被优选为备用。

4.2 故障检测与收敛

单纯依赖 BGP Keepalive (默认 60s/180s) 无法满足秒级切换要求,必须部署 BFD (Bidirectional Forwarding Detection)。

-

部署位置:

-

IDC Core Router <-> 专线对端 (VBR)

-

IDC Core Router <-> SD-WAN CPE (LAN 侧)

-

(可选) SD-WAN CPE <-> 云端 VPN (若支持 BFD over IPsec)

-

参数建议:

-

Min-Tx-Interval: 100ms (0.1 秒) -

Min-Rx-Interval: 100ms (0.1 秒) -

Detect-Multiplier: 3 (倍数) -

理论检测时间: 0.1×3=0.30.1×3=0.3 秒。

-

联动机制: 配置 BGP 与 BFD 联动 (

bfd all-interfaces或针对特定 neighbor)。一旦 BFD 检测到链路故障,立即通知 BGP 撤销邻居关系,触发路由重计算。

5. 关键技术对比:传统 IPsec vs. SD-WAN

在备用链路的技术选型上,本设计明确推荐 SD-WAN 替代传统手工配置的 IPsec,主要基于以下硬核技术优势:

5.1 配置简易化与自动化

| 维度 | 传统 IPsec VPN | SD-WAN 方案 | 技术解读 |

|---|---|---|---|

| 隧道建立 | 需手工配置阶段 1/2 参数 (加密算法、DH 组、PFS)、ACL 感兴趣流、接口绑定。易出现两端参数不匹配导致协商失败。 | 零接触配置 (ZTP)。仅需在 CPE 上配置 WAN 口上网,控制器自动下发隧道策略。 | 消除人为配置错误,部署时间从小时级缩短至分钟级。 |

| 路由注入 | 需配置复杂的策略路由 (PBR) 将流量引流至隧道接口;需手工维护静态路由或配置额外的路由协议进程。 | 自动路由学习。隧道建立后,BGP 路由自动通过 Overlay 传播,无需额外 PBR。 | 简化核心路由器配置,只需一条指向 CPE 的默认/静态路由。 |

| 变更管理 | 新增网段需同步修改两端 ACL 和路由表,操作繁琐且风险高。 | 策略驱动。在控制器界面添加网段,自动推送至所有节点。 | 适应敏捷业务需求,降低变更窗口风险。 |

5.2 可视化与智能运维

| 维度 | 传统 IPsec VPN | SD-WAN 方案 | 技术解读 |

|---|---|---|---|

| 状态可视 | 黑盒。仅能查看隧道 Up/Down 状态,无法感知底层互联网链路的实时质量 (延迟、抖动、丢包)。 | 全链路透视。提供端到端质量热力图,实时展示每条物理链路和逻辑隧道的 Latency, Jitter, Loss。 | 变“被动救火”为“主动预防”,在用户感知前发现劣化。 |

| 故障定界 | 困难。需登录设备抓包 (tcpdump,debug crypto),分析 ISAKMP/ESP 报文,依赖专家经验判断是本地配置问题还是运营商问题。 |

智能根因分析。系统自动区分是 隧道协议故障 还是 底层物理链路中断,并给出明确告警。 | 大幅降低 MTTR (平均修复时间),减少对高阶网络专家的依赖。 |

| 质量调度 | 无。一旦隧道建立,流量即固定,即使底层链路拥塞也不会自动切换。 | 智能选路。可设定策略:当延迟 > 50ms 或丢包 > 1% 时,自动将关键业务 (如 ERP/VOIP) 切换至其他可用链路。 | 最大化利用多链路资源,保障核心业务体验。 |

6. 风险评估与缓解措施

| 风险点 | 描述 | 缓解措施 (Mitigation) |

|---|---|---|

| 路由环路 | 云端路由经 VPN 传回 IDC,又经专线传回云端,形成环路。 | 1. 严格的路由过滤:只通告特定业务网段。2. AS-Path Prepend:确保备用路径属性劣于主路径。3. 启用 BGP 路由阻尼 (Dampening)。 |

| MTU 黑洞 | 隧道封装导致大包丢弃,表现为部分业务不通或速度极慢。 | 1. 全网统一 MTU 规划 (隧道侧 1400)。2. 强制开启 TCP MSS Clamping。3. 上线前进行 ping -f -l 大包测试。 |

| 公网抖动 | 备用链路依赖互联网,极端情况下可能不可用。 | 1. 双运营商接入: CPE 配置双 WAN 口,分别接入电信/联通,构建最后一道冗余。2. 设置质量阈值,劣化时自动降级而非强行切换。 |

| 脑裂 (Split-Brain) | 专线链路出现单向故障,导致两端路由状态不一致。 | 依赖 BFD 双向检测 机制,单向故障亦会触发 BFD Down,从而关闭 BGP 会话,确保状态一致。 |

7. 实施验证清单

在割接上线前,高级网络工程师需完成以下验证:

###1. 连通性测试:

1. 专线互联地址 Ping 通。

2. SD-WAN 隧道建立成功 (State = Established)。

3. 端到端业务网段 Ping 通 (测试 64Byte 及 1400Byte 包)。

###2. 路由表检查:

1. Core Router 路由表中,云网段下一跳指向专线,Priority/Local\_Pref 符合预期。

2. 阿里云路由表中,IDC 网段优先匹配专线来源。

###3. 故障切换演练 (必须执行):

1. 模拟专线故障: 拔掉专线光纤或 Shutdown 接口。

2. 计时: 记录从故障发生到业务恢复的时间 (目标 < 4s)。

3. 验证: 确认流量已切换至 SD-WAN 路径 (通过 Traceroute 验证跳数变化)。

4. 恢复: 恢复专线,确认流量自动回切,且无震荡。

###4. 可视化验证:

1. 登录 SD-WAN 控制器,确认能看到实时的链路质量图表。

2. 模拟丢包/延迟,确认控制器产生相应告警。

双专线接入阿里云:BGP+BFD实现故障切换实测

云边协同架构下的智能仓储系统:SD-WAN 网络设计与部署

高可用云网络架构:最后一公里双轨 + 骨干网双活

多云互联 BFD 协议失效故障复盘与韧性架构设计指南

专线 + SD-WAN 异构双路径接入阿里云高可用架构实战