高可用云网络架构:最后一公里双轨 + 骨干网双活

发布日期: 2026-03-20作者: 解决方案架构师/项目实施部浏览: 276

1. 设计概述

本设计方案旨在构建一套高可用、低延迟、全可视的混合云网络架构。基于犀思云融合网络(FusionWAN),采用“三层云网络”设计:

- 接入层(Last Mile):IDC 至犀思云 POP 点,采用 “物理专线(主)+ SD-WAN 互联网(备)” 异构双链路,实现成本与可靠性的最佳平衡。

- 骨干层(Backbone):犀思云全球骨干网内部,通过多 PE 节点互联,提供 SLA 保障的私有传输通道。

- 云端层:犀思云 POP 点至阿里云,采用 “双线专线双活” 模式,消除云端单点故障,实现真正的端到端冗余。

核心价值主张:

- 高可靠性:从 IDC 到 VPC,无任何单点故障(SPOF)。即使物理专线中断,业务无感知切换;即使云端单条专线故障,流量自动负载均衡。

- 智能选路:动态路径选择,确保关键业务始终运行在最优链路上。

- 统一运维:单一控制台管理全网拓扑、质量监控、策略下发,告别多厂商扯皮。

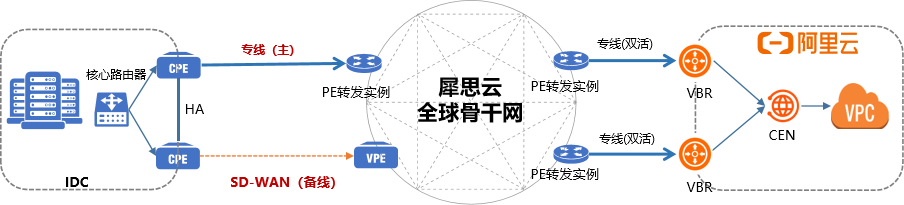

2. 逻辑拓扑架构

2.1 总体架构图解

2.2 组件角色与功能定义

| 层级 | 组件 | 角色定位 | 关键协议/功能 | 设计约束 |

|---|---|---|---|---|

| 接入层 | 核心路由器 | 本地路由决策中心 | eBGP, BFD | 需支持与犀思云 CPE 建立邻居,不直接参与广域网选路。 |

| 犀思云 CPE | 智能边缘网关 | IPsec/GRE, Overlay BGP, QoS, Link Health Probe | 同时纳管物理专线和互联网线路,执行主备切换逻辑。双 CEP 做 HA,实现设备自动切换。 | |

| 骨干层 | PE 节点 / VPE | 流量汇聚与转发 | MPLS/SRv6, Segment Routing | 犀思云全球分布式部署,提供低延迟、高带宽的私有传输。 |

| SDN 控制器 | 网络大脑 | Telemetry, Path Computation, Policy Enforcement | 实时监控全网链路质量,动态调整路由策略。 | |

| 云端层 | 阿里云 VBR x2 | 云端接入点 | BGP over Direct Connect | 两个独立 VBR 实例,分别连接不同 PE 节点,构成双活。 |

| 阿里云 CEN | 云端路由枢纽 | Route Table, Route Map | 接收来自两个 VBR 的路由,进行负载分担或主备优选。 |

3. 寻址与网络规划

为确保路由可达性并避免冲突,必须严格遵循以下地址规划原则。所有网段不得重叠。

3.1 互联地址规划

| 链路类型 | 位置 | 接口描述 | 建议网段 (CIDR) | 备注 |

|---|---|---|---|---|

| IDC 内联 | Core <-> CPE | LAN Interface | 192.168.100.0/30 |

用于 BGP 邻居建立 |

| Core <-> FW | LAN Interface | 192.168.101.0/30 |

用于主链路直连(可选) | |

| 最后一公里 | CPE WAN1 (专线) | To Xisys POP | DHCP / Static Public IP | 由犀思云分配或客户自配 |

| CPE WAN2 (公网) | To Internet | DHCP / Static Public IP | 需固定公网 IP 以简化 ACL | |

| 骨干网隧道 | CPE <-> VPE | Tunnel Interface | 10.255.0.0/30(示例) |

犀思云控制器自动分配 Link-Local 地址 |

| 云端接入 | PE-B1 <-> VBR1 | Cloud Interconnect | 10.255.1.0/30 |

阿里云侧通常为 .1 |

| PE-B2 <-> VBR2 | Cloud Interconnect | 10.255.2.0/30 |

阿里云侧通常为 .1 |

3.2 业务网段规划

| 区域 | 业务网段示例 | 通告方式 | 备注 |

|---|---|---|---|

| 本地 IDC | 10.10.0.0/16(DB/App) |

由 CPE 通过 BGP 通告至骨干网 | 需在犀思云控制台配置“本地网段” |

| 阿里云 VPC | 172.16.0.0/16 |

由 VBR 通过 BGP 通告至 CEN,再下传至骨干网 | 云端需配置路由发布策略 |

3.3 MTU 与 MSS 规划

由于存在多层封装(IPsec + GRE + VXLAN 等),必须精确计算 MTU。

- 物理接口 MTU: 1500 Bytes (标准以太网)

- 犀思云隧道接口 MTU: 1400 Bytes (控制器自动下发)

- TCP MSS Clamping:

- 在 Core Router 连接 CPE 的接口配置:

tcp mss adjust 1360 -

- 在 犀思云 CPE 的 LAN 侧接口配置:

tcp mss adjust 1360

- 在 犀思云 CPE 的 LAN 侧接口配置:

- 目的: 防止因分片导致的性能下降或连接失败。

4. 路由策略与控制平面设计

本方案采用 分层路由控制 模型:

- 第一层(IDC 内部):Core Router 与犀思云 CPE 之间运行 eBGP/iBGP,仅交换业务网段路由。

- 第二层(广域网):犀思云控制器基于全局视图,智能计算最优路径,并下发至各 PE/CPE 节点。

- 第三层(云端内部):阿里云 CEN 作为路由反射器,接收来自两个 VBR 的路由,并根据策略进行负载分担或主备优选。

4.1 去程流量 (IDC -> Cloud) 选路逻辑

4.1.1 最后一公里选路 (CPE 决策)

机制: 犀思云 CPE 实时探测两条 WAN 链路的质量(延迟、丢包、抖动)。

策略:

- 正常状态: 优先使用 物理专线(标记为

Primary,Metric=10)。 - 故障状态: 当专线质量低于阈值(如丢包 >5% 或延迟 >100ms),自动切换至 SD-WAN 互联网链路(标记为

Backup,Metric=20)。 - 恢复状态: 专线质量恢复后,自动回切(可配置延迟回切避免震荡)。

实现: 此逻辑完全由犀思云控制器自动执行,无需客户在 Core Router 上配置复杂策略。

4.1.2 骨干网及云端选路 (控制器决策)

机制: 流量进入犀思云骨干网后,控制器根据目的地(阿里云 Region)和当前网络拥塞情况,选择最优 PE 出口。

云端双活处理:

- 犀思云两个 PE 节点(B1, B2)均向阿里云 VBR 通告相同的 IDC 网段 (

10.10.0.0/16)。 - 在阿里云侧,可通过 AS-Path Prepend 或 Local Preference 控制哪个 VBR 优先被选中(如果需要非对称负载)。

- 推荐做法: 让阿里云 CEN 自动进行 ECMP(等价多路径)负载分担,最大化利用两条专线带宽。

4.2 回程流量 (Cloud -> IDC) 选路逻辑

4.2.1 云端路由策略 (CEN 决策)

目标: 确保回程流量也遵循“专线优先”的原则,避免非对称路由。

实现:

- 在阿里云 CEN 中,为从 VBR1 和 VBR2 学到的路由设置不同的 优先级。

- 例如:VBR1 (对应 PE-B1) 设置为高优,VBR2 (对应 PE-B2) 设置为低优。

- 更精细的做法是:在犀思云侧,当主用专线活跃时,只通过 PE-B1 通告路由;当主用专线故障时,才通过 PE-B2 通告路由(需控制器联动)。

- 简化方案: 依赖阿里云 CEN 的默认行为——如果两条路由属性相同,则自动做 ECMP。这通常是可以接受的,因为两条都是高质量专线。

4.2.2 最后一公里回程 (CPE 决策)

- 机制: 与去程一致,CPE 根据当前活跃的 WAN 链路接收流量。

- 关键点: 由于主备切换发生在 CPE 层面,对于阿里云和骨干网而言,下一跳始终是犀思云的 PE 节点,因此回程路由无需频繁变更,保证了稳定性。

4.3 故障检测与收敛 (Failure Detection & Convergence)

BFD (Bidirectional Forwarding Detection):

- 在 Core Router <-> 犀思云 CPE 之间启用 BFD,检测时间 < 300ms。

- 在 犀思云 CPE <-> 云端 VPE 之间,由犀思云内置机制实现毫秒级探测。

- 在 阿里云 VBR <-> 犀思云 PE 之间,启用 BGP BFD(若阿里云支持)。

收敛时间:

- 最后一公里切换:< 1 秒(犀思云智能切换)。

- 骨干网重路由:< 500ms(SDN 快速收敛)。

- 云端双活切换:< 1 秒(BGP + BFD)。

- 端到端 RTO: < 2 秒,满足绝大多数金融、ERP 系统要求。

5. 关键技术对比:传统方案 vs. 犀思云三层架构

| 维度 | 传统自建方案 (多厂商拼凑) | 犀思云三层云网络方案 | 技术优势解读 |

|---|---|---|---|

| 架构复杂度 | 高:需协调专线运营商、IPsec 设备、云厂商三方配置。 | 低:单一平台统一管理,自动化部署。 | 减少人为错误,缩短交付周期 70%。 |

| 高可用性 | 中:依赖本地路由器 BFD+BGP,切换慢且易出错。 | 极高:端到端智能感知,毫秒级切换,无单点故障。 | 真正实现“永远在线”,SLA 可达 99.99%。 |

| 路由控制 | 复杂:需在多个设备上手工配置 Route-Map、Prepend 等。 | 智能:基于应用和链路质量的动态选路,策略可视化。 | 从“静态配置”升级为“动态优化”,提升用户体验。 |

| 运维可视性 | 黑盒:无法看到公网链路质量,排障困难。 | 全透视镜:端到端质量热力图,智能根因分析。 | 变“被动救火”为“主动预防”,MTTR 降低 80%。 |

| 成本效益 | 高:专线成本高,且需额外购买 SD-WAN 许可证。 | 优:按需订阅,弹性带宽,复用现有互联网线路。 | TCO(总拥有成本)降低 30%-50%。 |

6. 风险评估与缓解措施

| 风险点 | 描述 | 缓解措施 |

|---|---|---|

| 路由环路 | 云端路由经一个 VBR 传入,又从另一个 VBR 传出,形成环路。 | 1. 在阿里云 CEN 配置路由过滤,禁止将学习到的 IDC 路由再次通告回 VBR。2. 启用 BGP AS-Path 检查。 |

| MTU 黑洞 | 多层封装导致大包丢弃。 | 1. 严格执行 MTU/MSS 规划。2. 上线前进行 ping -f -l 大包测试。3. 犀思云控制器自动协商隧道 MTU。 |

| 公网抖动影响备用链路 | 极端情况下,互联网链路不可用。 | 1. 双运营商接入: CPE 配置双 WAN 口,分别接入电信/联通。2. 设置质量阈值,劣化时自动降级而非强行切换。 |

| 云端单 VBR 故障 | 一条云专线中断。 | 双活架构天然免疫:另一条专线立即接管全部流量,业务无感知。 |

| 控制器依赖 | 犀思云控制器宕机导致无法切换。 | 1. 控制器集群部署,高可用架构。2. CPE 设备具备本地决策能力,在失联时仍可基于预设策略切换。 |

7. 实施验证清单

在割接上线前,高级网络工程师需完成以下验证:

- 连通性测试:

- IDC 到阿里云 VPC 双向 Ping 通(小包 & 大包)。

- 验证主备链路均可独立承载业务流量。

- 路由表检查:

- Core Router 路由表中,云网段下一跳指向犀思云 CPE。

- 阿里云 CEN 路由表中,IDC 网段通过两个 VBR 学习到(ECMP 或主备)。

- 故障切换演练 (必须执行):

- 模拟专线故障: 拔掉 CPE 专线 WAN 口。

* 计时:记录业务恢复时间(目标 < 2s)。

* 验证:Traceroute 确认路径已切换至互联网。

- 模拟云端单线故障: 在阿里云控制台禁用一个 VBR。

* 验证:流量自动切换到另一条专线,无丢包或极少丢包。

- 恢复测试: 恢复故障链路,确认流量自动回切,无震荡。

- 可视化验证:

- 登录犀思云控制台,确认能看到实时的链路质量图表和拓扑状态。

- 模拟丢包/延迟,确认控制器产生相应告警并记录事件。

8. 总结与可扩展性

本方案通过构建“最后一公里异构双轨 + 骨干网双活”的三层架构,从工程实践角度解决了传统混合云网络在故障域隔离、路由收敛确定性、以及运维可观测性方面的核心痛点。

对于架构师与技术决策者而言,该设计的核心价值在于:

- 确定性的 SLA 保障:

通过将不可控的公共互联网(作为备用)与受控的物理专线/私有骨干网(作为主用)进行逻辑解耦,并利用犀思云控制器的实时质量探测实现毫秒级切换,我们将网络可用性从“尽力而为”提升到了可量化、可承诺的工程级别。

2. 架构的弹性与解耦:

该设计实现了控制平面与数据平面的分离,以及接入层与核心层的解耦。

- 横向扩展:未来新增分支机构或多云节点(华为云/腾讯云/火山云/AWS/Azure)时,只需部署边缘 CPE 并注册至控制器,无需重构核心路由策略。

- 纵向演进:当业务流量模型发生变化(如从南北向为主转为东西向互联),可通过软件定义策略动态调整路径,无需硬件割接。

- 运维范式的转变:

从传统的“基于设备 CLI 的配置驱动”转变为“基于业务意图的策略驱动”。端到端的可视化遥测数据(延迟、丢包、抖动)让网络状态从“黑盒”变为“白盒”,显著降低了平均故障修复时间(MTTR),使网络团队能将精力从底层连通性维护转移到上层业务体验优化。

技术建议:

建议在实施阶段,重点关注 BFD 参数调优与 MSS 分片策略的落地验证,并在生产环境建立基线性能指标。此架构不仅满足了当前高可用上云的刚需,更为未来构建全球一张网及支持实时性敏感业务(如 VoIP、视频协作、数据库同步)奠定了坚实的底层传输基础。

附录: 网络运维专属免费工具箱

双专线接入阿里云:BGP+BFD实现故障切换实测

云边协同架构下的智能仓储系统:SD-WAN 网络设计与部署

高可用云网络架构:最后一公里双轨 + 骨干网双活

多云互联 BFD 协议失效故障复盘与韧性架构设计指南

专线 + SD-WAN 异构双路径接入阿里云高可用架构实战